引言:数字化转型的数据困境

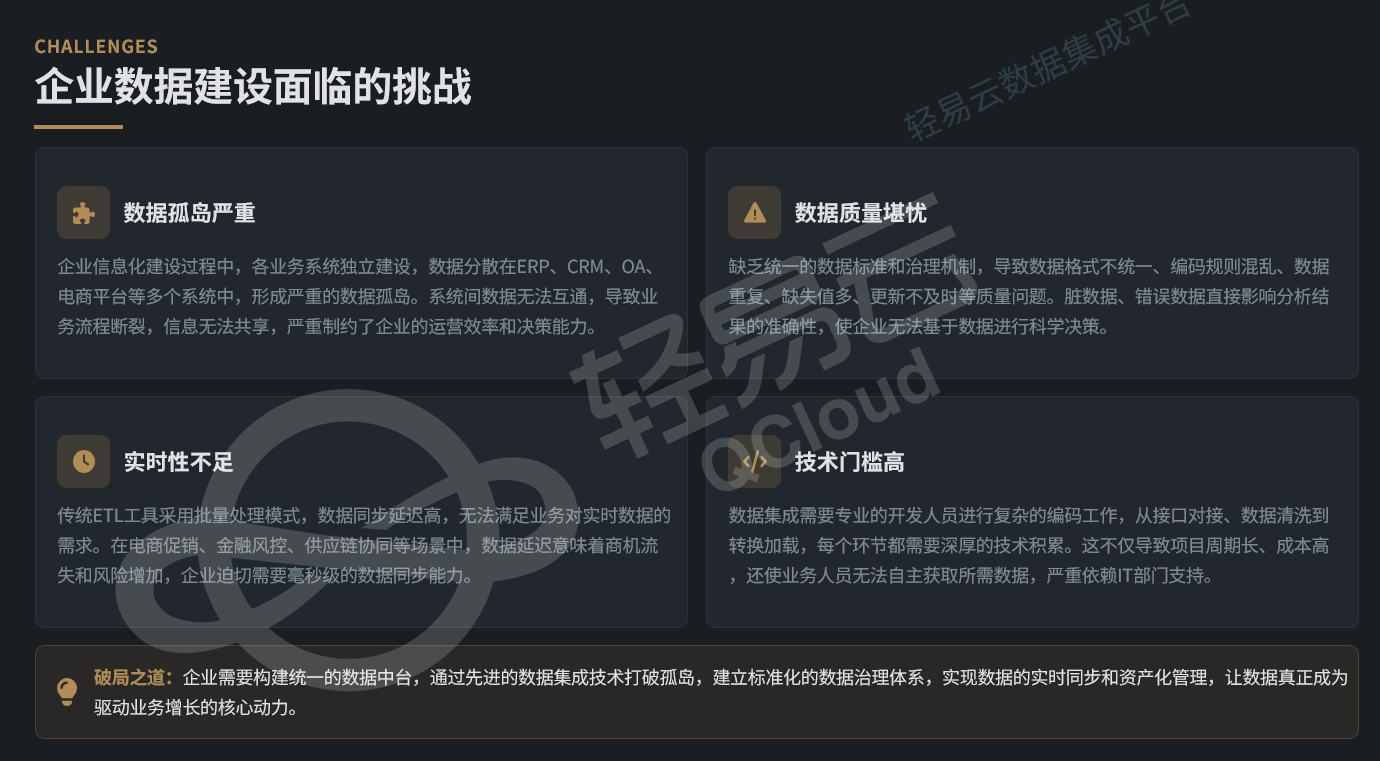

在企业信息化建设过程中,随着业务系统的不断增加,数据分散在ERP、CRM、OA、电商平台等多个独立系统中,形成严重的数据孤岛。系统间数据无法互通导致业务流程断裂,信息无法共享。同时,由于缺乏统一的数据标准,数据格式不统一、编码规则混乱、重复数据多、缺失值多等问题普遍存在,脏数据直接影响分析结果的准确性。

传统ETL工具多采用批量处理模式,数据同步延迟高,无法满足电商促销、金融风控、供应链协同等场景对实时数据的需求。此外,数据集成工作通常需要专业开发人员进行复杂的编码工作,从接口对接到数据清洗,每个环节都需要深厚的技术积累,导致项目周期长、成本高,业务人员无法自主获取所需数据,严重依赖IT部门支持。

构建统一的数据中台,通过先进的数据集成技术打破孤岛,建立标准化的数据治理体系,实现数据的实时同步和资产化管理,已成为企业数字化转型的必然选择。

一、数据中台整体架构

1.1 分层架构设计

数据中台通常采用五层架构模型:

数据源层:包含业务数据库、ERP/CRM系统、云服务、IoT设备、日志文件、消息队列等,是数据的原始产生地。

数据采集层:负责多源异构数据的接入,包括批量同步、实时CDC(Change Data Capture)、日志采集、API接入等方式。

数据存储层:包含数据仓库、数据湖、OLAP引擎(如Greenplum、ClickHouse)和缓存层,支撑PB级数据存储和毫秒级查询响应。

数据计算层:提供离线计算、实时计算、交互分析和机器学习能力,满足多样化数据处理需求。

数据服务层:通过API网关、服务编排、流量控制和安全认证,将数据能力开放为标准化服务。

数据应用层:支撑数据大屏、管理驾驶舱、智能报表、自助分析和AI应用。

1.2 核心技术栈

数据采集层采用CDC、ETL/ELT技术和消息队列;存储计算层基于MPP数据库、列式存储和流计算引擎;数据服务层支持REST API、GraphQL和微服务架构;数据治理层利用元数据管理工具实现数据血缘追踪。

架构设计遵循云原生弹性扩展、存算分离、离线与实时一体化等原则,确保系统的可扩展性和高可用性。

二、数据集成解决方案

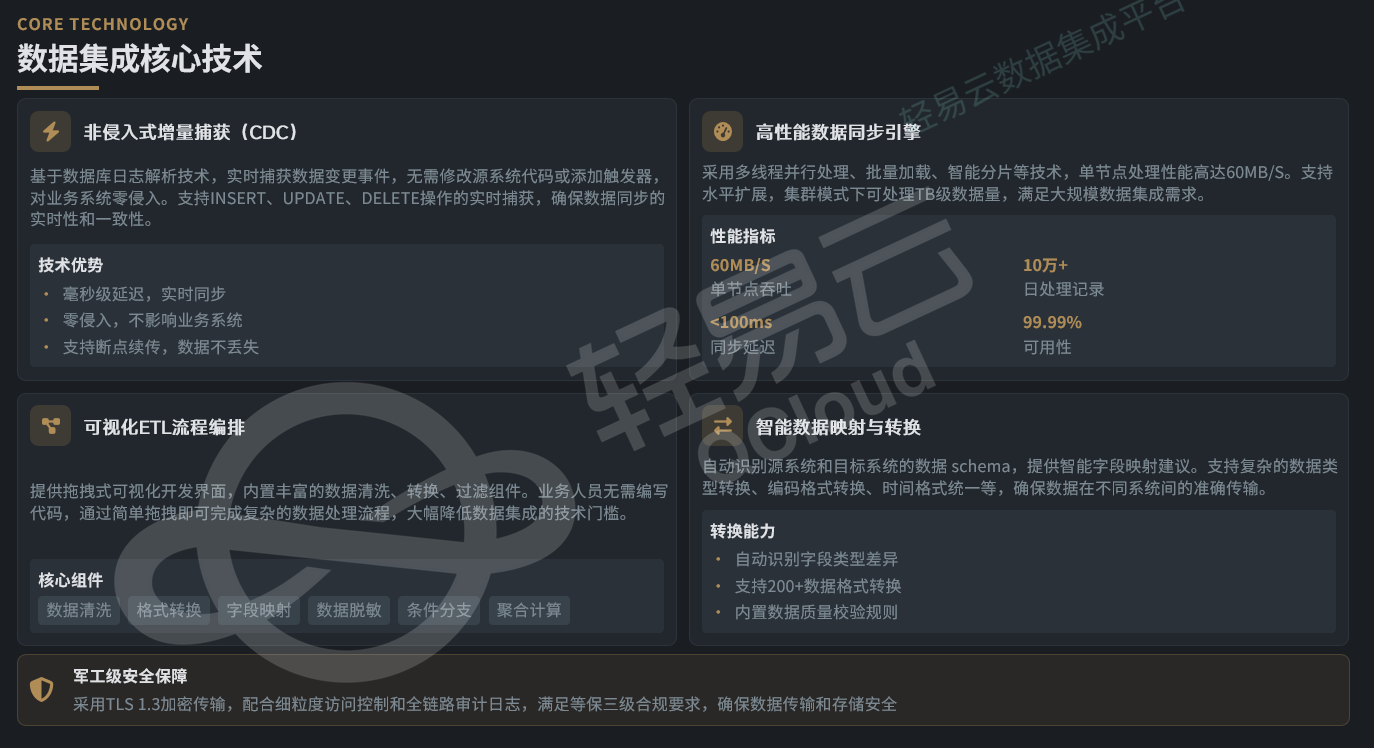

2.1 非侵入式增量捕获技术

CDC(Change Data Capture)技术基于数据库日志解析,实时捕获INSERT、UPDATE、DELETE等数据变更事件,无需修改源系统代码或添加触发器,对业务系统零侵入。该技术支持断点续传,确保数据不丢失,可实现毫秒级延迟的实时同步。

2.2 高性能同步引擎

通过多线程并行处理、批量加载和智能分片技术,单节点处理性能可达60MB/s。系统支持水平扩展,集群模式下可处理TB级数据量,满足大规模数据集成需求。同步过程采用TLS加密传输,配合细粒度访问控制和审计日志,满足企业级安全合规要求。

2.3 可视化ETL流程

现代数据集成平台提供拖拽式可视化开发界面,内置数据清洗、格式转换、字段映射、数据脱敏、条件分支、聚合计算等组件。业务人员无需编写代码,通过简单拖拽即可完成复杂的数据处理流程。系统可自动识别源系统和目标系统的Schema,提供智能字段映射建议,支持200多种数据格式转换。

2.4 多源异构数据接入

企业级数据中台通常支持多种数据源类型:

- 关系型数据库:MySQL、Oracle、SQL Server、PostgreSQL等

- 大数据平台:Hadoop、Hive、HBase、Kafka等

- 云服务平台:阿里云、腾讯云、AWS等

- 业务应用系统:金蝶、用友、SAP等ERP系统

接入方式包括数据库直连(JDBC)、API接口对接(REST)、文件导入(CSV/Excel)和消息队列(MQ/Kafka)。

三、数据仓库建设方案

3.1 分层架构模型

企业级数据仓库采用经典的分层架构设计:

ODS(贴源数据层):存储原始数据镜像,与源系统数据结构保持一致,支持数据回溯和审计。

DWD(明细数据层):对ODS层数据进行清洗转换,保持数据粒度不变,统一数据标准和编码规范。

DWS(汇总数据层):按业务主题域汇总数据,构建宽表模型,支持多维分析和报表查询。

ADS(应用数据层):面向具体业务场景的数据集市,提供直接可用的数据服务。

分层设计遵循数据解耦、可追溯性、复用性和性能优化原则,上层数据可复用下层数据资产,针对不同场景优化存储和计算。

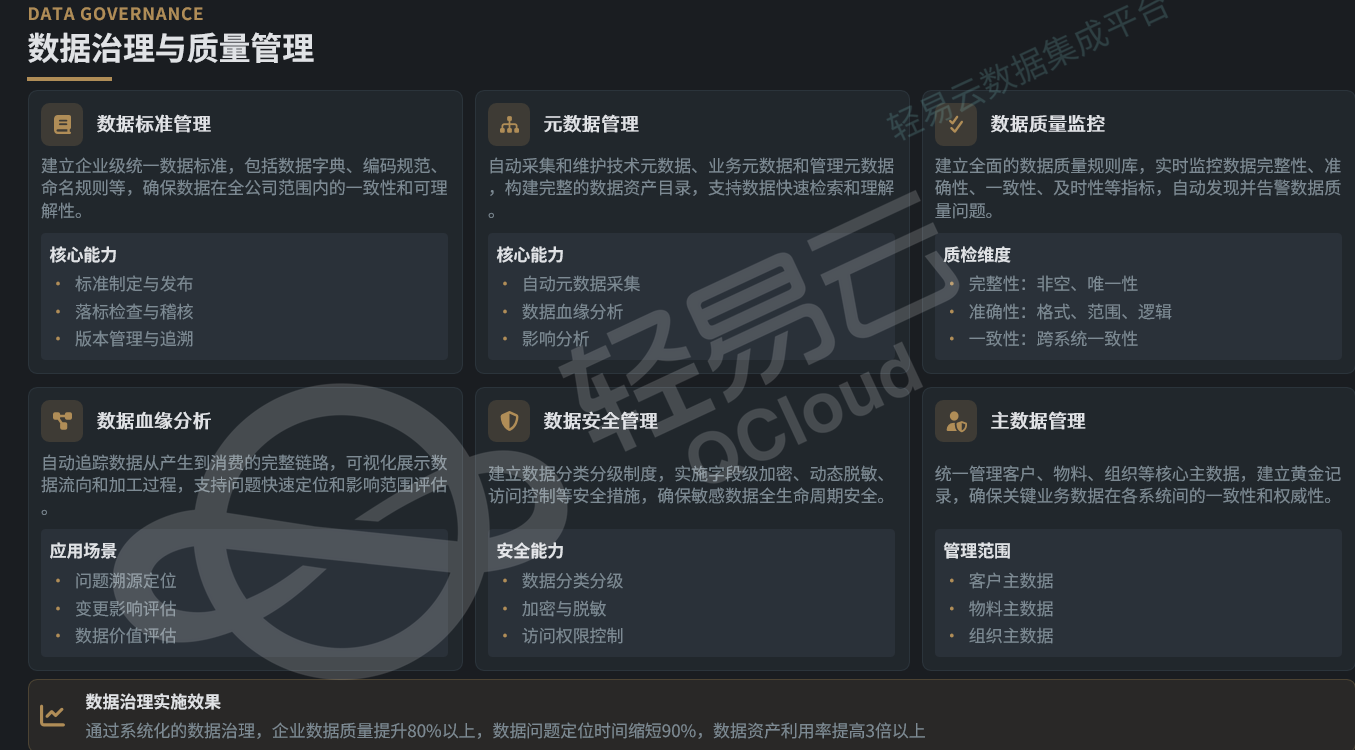

3.2 数据治理体系

数据标准管理:建立企业级统一数据字典、编码规范和命名规则,确保数据在全公司范围内的一致性。通过落标检查与稽核,自动验证数据合规性。

元数据管理:自动采集技术元数据、业务元数据和管理元数据,构建完整的数据资产目录。通过数据血缘分析,可视化展示数据从产生到消费的完整链路,支持问题快速定位和影响范围评估。

数据质量监控:建立全面的数据质量规则库,从完整性(非空、唯一性)、准确性(格式、范围、逻辑)和一致性(跨系统一致性)等维度实时监控数据质量,自动发现并告警数据质量问题。

数据安全管理:建立数据分类分级制度,实施字段级加密、动态脱敏和访问控制。基于RBAC模型,实现库、表、字段级别的精细化权限控制,以及行级数据权限,确保敏感数据全生命周期安全。

主数据管理:统一管理客户、物料、组织等核心主数据,建立黄金记录,确保关键业务数据在各系统间的一致性和权威性。

3.3 数据资产化管理

构建企业级数据资产目录,提供统一的数据检索和发现入口,支持按业务主题、数据类型、数据来源等多维度分类。建立多维度的数据标签体系,对数据进行业务化标注,提升数据的可理解性和可用性。

通过系统化的数据治理,企业数据质量通常可提升80%以上,数据问题定位时间缩短90%,数据资产利用率提高3倍以上。

四、数据分析与应用

4.1 多维数据分析

即席查询:提供类SQL的自助查询能力,支持可视化查询构建器,业务人员通过拖拽式选择表、字段、过滤条件即可自动生成查询语句。

OLAP分析:支持上卷、下钻、切片、切块、旋转等OLAP操作,实现多维度数据透视分析。采用列式存储和预计算技术,可秒级响应亿级数据量的查询需求。

数据挖掘:内置机器学习算法库,支持分类(决策树、随机森林)、聚类(K-Means、DBSCAN)、预测(时间序列、回归)和关联分析(Apriori、FP-Growth)等任务,提供可视化建模界面。

智能报表:提供丰富的图表组件和报表模板,支持交互式筛选器、定时推送、权限控制和多格式导出(PDF/Excel)。

4.2 数据服务化

通过一键API生成能力,将数据表或SQL查询快速封装为标准RESTful API或GraphQL接口,无需编写代码即可分钟级完成数据服务发布。API网关提供流量控制(QPS限制)、访问鉴权(Token/OAuth2)、熔断降级和实时监控告警能力,确保数据服务的高可用性和安全性。

数据服务化使业务系统可以实时调用数据能力,支撑客户信息查询、订单状态跟踪、智能推荐、风险预警等场景。

4.3 数据可视化与智能应用

数据大屏:打造沉浸式数据可视化大屏,实时展示核心业务指标和运营态势,支持多屏联动、自动刷新和告警提示。

管理驾驶舱:为各级管理者定制专属数据驾驶舱,聚焦关键业务指标(KPI),支持多维度下钻分析和智能预警推送。

AI智能分析:融合机器学习技术,提供客户360°画像、精准营销推荐、异常行为检测和需求预测等应用。整合多源数据构建客户画像,包括基础属性、行为特征、消费偏好和价值分层等标签,支持人群细分和相似人群扩展(Lookalike),赋能精准营销。

五、实施路径与最佳实践

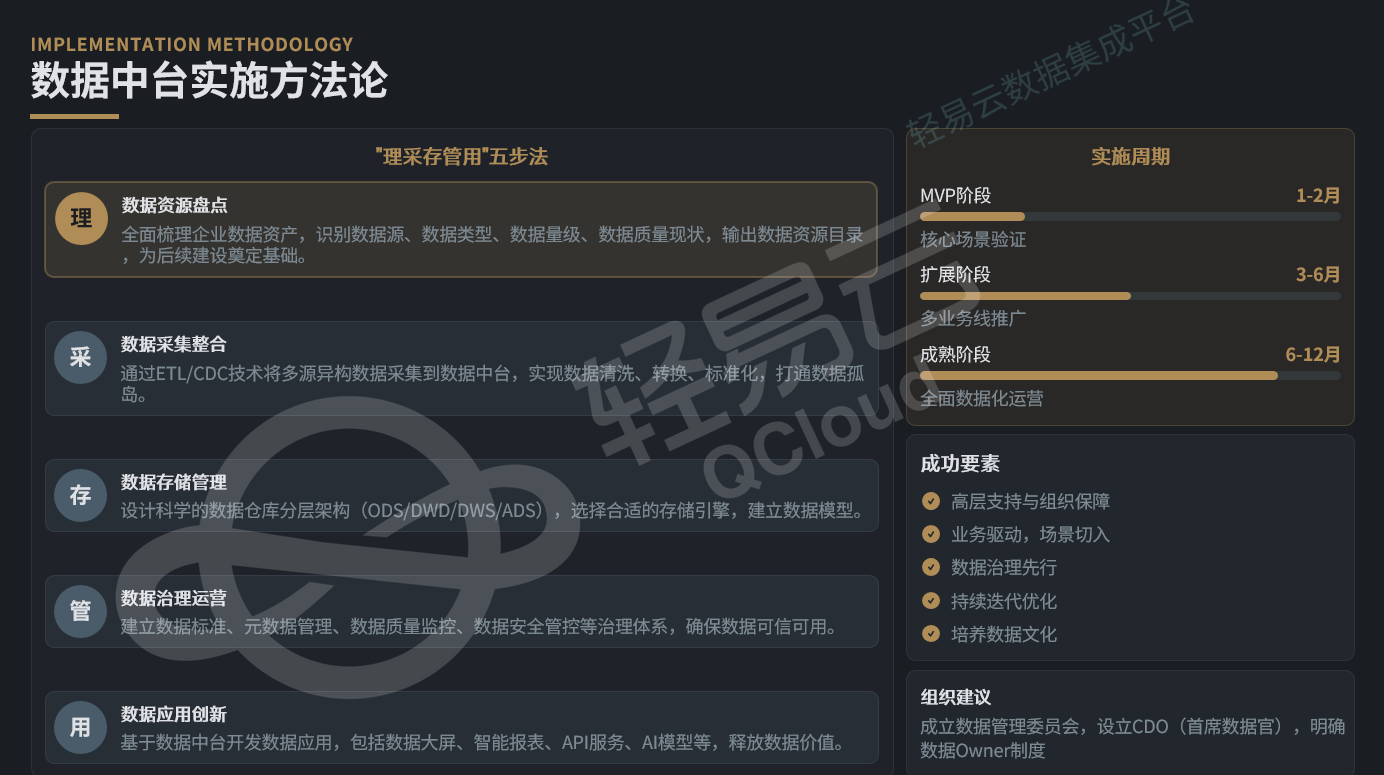

5.1 "理采存管用"五步法

理(数据资源盘点):全面梳理企业数据资产,识别数据源、数据类型、数据量级和数据质量现状,输出数据资源目录,为后续建设奠定基础。

采(数据采集整合):通过ETL/CDC技术将多源异构数据采集到数据中台,实现数据清洗、转换和标准化,打通数据孤岛。

存(数据存储管理):设计科学的数据仓库分层架构,选择合适的存储引擎(如Greenplum、ClickHouse),建立数据模型。

管(数据治理运营):建立数据标准、元数据管理、数据质量监控和数据安全管控等治理体系,确保数据可信可用。

用(数据应用创新):基于数据中台开发数据应用,包括数据大屏、智能报表、API服务和AI模型,释放数据价值。

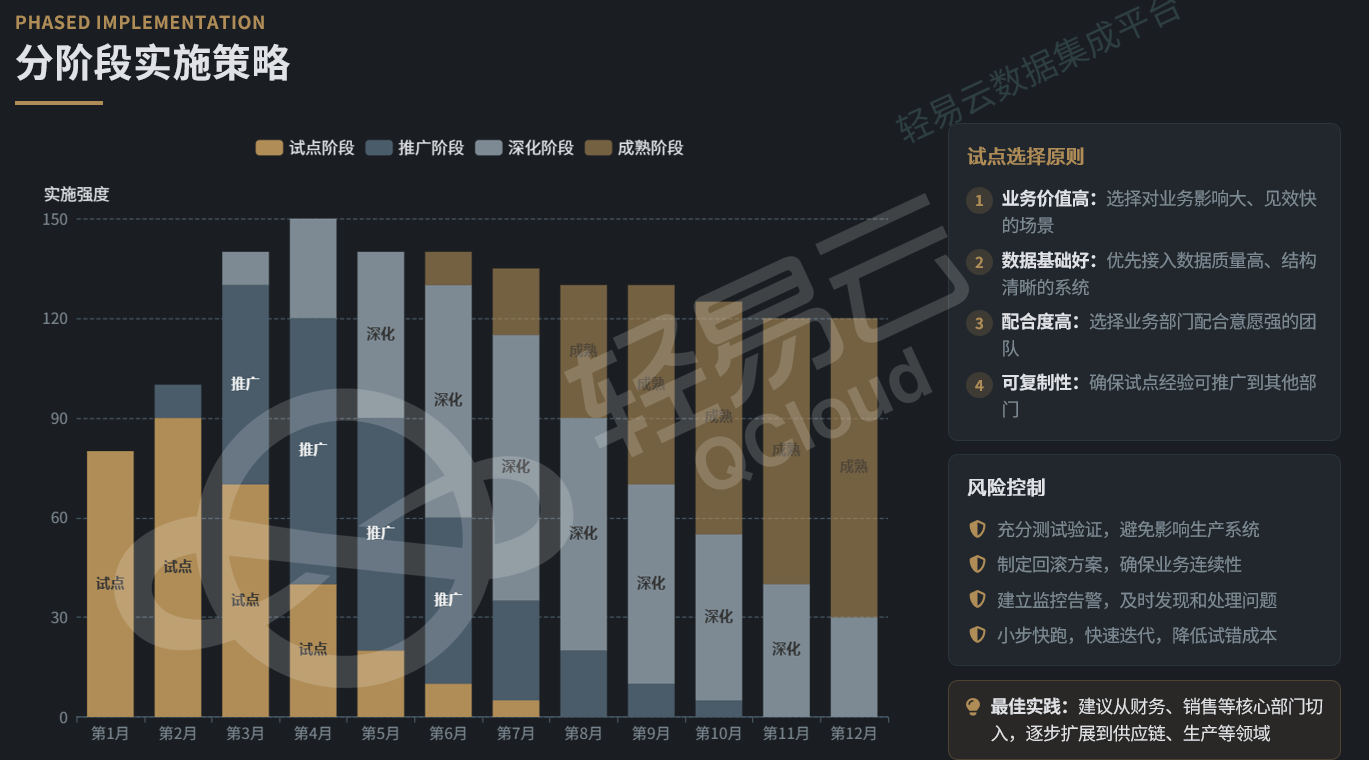

5.2 分阶段实施策略

MVP阶段(1-2个月):选择业务价值高、数据基础好的核心场景进行试点验证,建立技术框架和基础能力。

扩展阶段(3-6个月):基于试点经验,将数据中台推广到多业务线,完善数据治理体系。

成熟阶段(6-12个月):实现全面数据化运营,建立数据驱动的决策文化,持续优化和迭代。

5.3 关键成功因素

高层支持与组织保障:成立数据管理委员会,设立首席数据官(CDO),明确数据Owner制度,确保项目获得足够的资源和支持。

业务驱动,场景切入:从财务、销售等核心部门切入,选择对业务影响大、见效快的场景,确保业务部门配合意愿强。

数据治理先行:在建设初期即建立统一的数据标准和治理体系,避免先污染后治理。

小步快跑,快速迭代:采用敏捷方法论,充分测试验证,制定回滚方案,降低试错成本。

培养数据文化:通过培训和推广,提升全员数据素养,让业务人员能够自助使用数据。

5.4 风险控制

- 充分测试验证,避免影响生产系统

- 制定详细的回滚方案,确保业务连续性

- 建立完善的监控告警机制,及时发现和处理问题

- 优先接入数据质量高、结构清晰的系统,降低实施风险